В течение многих лет и даже десятилетий видимость бренда в основном сводилась к конкуренции с другими компаниями в области SEO. Однако с появлением ChatGPT, Perplexity, Claude и AI Mode с AI Overviews в Google ситуация сильно поменялась: на первый план вышла видимость бренда в ИИ‑ответах. А технические лазейки, которые раньше помогали бренду быстро адаптироваться и оставаться конкурентоспособным на протяжении многих лет, сейчас могут сыграть против вас.

Для каждой проблемы, конечно, существует решение. Однако главная сложность не в технических деталях и не в некомпетентности, а в том, что источник проблемы не всегда можно определить наверняка.

Это скрытые проблемы в стратегии, которые подрывают тактику и усилия команды. Их и надёжность технического SEO‑подхода разбираем в статье.

На что обратить внимание в техничке

Высокие позиции в поиске ≠ видимость для ИИ

Одно из самых опасных заблуждений — считать, что если сайт занимает высокие позиции в Google, значит, его техническая основа безупречна. Логика кажется простой: если поисковые системы без проблем сканируют сайт и индексируют контент, то же самое должно сработать и для ИИ.

📊 Узнайте позиции своего сайта с помощью Топвизора

В инструменте Проверка позиций сайта можно узнать, какие позиции в ТОПе поисковой выдачи занимает ваш сайт, а ещё бесплатно проверять позиции пяти сайтов конкурентов. Поддерживаются все регионы и языки, доступные в поисковиках. Хотите проверять позиции в Google в Бразилии с португальским языком? Для Топвизора это не проблема!

Но это не так. На самом деле здесь есть несколько проблемных точек. Одно заблуждение тянет за собой другое, и в итоге рухнуть может вся стратегия.

Недавно Search Engine Journal провели сравнение данных для двух крупных сайтов — Airbnb и Vrbo.

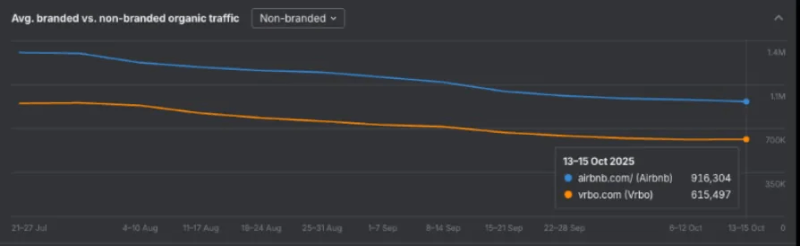

Если рассматривать поисковые запросы без упоминания бренда, то с июля наблюдается снижение популярности обоих сайтов. По последним доступным данным на 13–15 октября 2025 года, Airbnb фигурирует примерно в 916 304 запросах, а Vrbo — в 615 497. Соотношение составляет примерно 3:2.

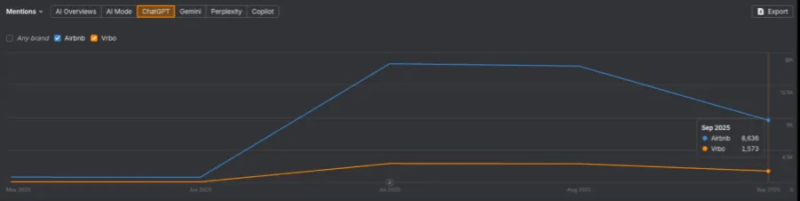

Однако если посмотреть на предполагаемое количество упоминаний в ChatGPT за сентябрь 2025 года, картина меняется: Airbnb упоминается примерно 8 636 раз, а Vrbo — лишь 1 573. Здесь соотношение уже около 11:2.

Хотя Vrbo присутствует в обычных результатах поиска Google, его роль в обзорах и режиме ИИ значительно ниже. Это объясняется тем, что функции ИИ в Google по‑прежнему в значительной мере опираются на ту же поисковую инфраструктуру.

В ИИ‑поиске цена технических ошибок выше

Если сайт хорошо ранжируется в Google, это не означает, что технические недостатки отсутствуют.

Поисковая инфраструктура Google очень сложна и учитывает гораздо больше факторов, чем ИИ‑краулеры на данный момент. Совокупный эффект этих факторов может компенсировать или скрыть небольшие технические проблемы.

Например, страница с хорошо оптимизированным текстом, структурированной разметкой и достаточным авторитетом может занимать более высокое место в рейтинге, чем страница конкурента, даже если загружается немного медленнее.

Однако большинство ИИ‑краулеров работают иначе. Они удаляют код, форматирование и разметку, оставляя только исходный текст. Из‑за меньшего количества факторов, способных уравновесить ситуацию, всё, что мешает краулеру получить доступ к контенту, оказывает большее влияние на видимость в ИИ‑поиске. В таких условиях технические недостатки играют критически важную роль.

Как работают AI Mode и AI Overviews и почему нам необходимы новые SEO‑стратегии — на основе патентов

На первом плане скорость загрузки

Давайте подробнее остановимся на одной из самых распространённых технических проблем — скорости загрузки страницы. Неоптимальная скорость редко является следствием одной причины. Обычно она возникает из‑за сочетания нескольких факторов:

-

раздутый код;

-

неэффективный CSS;

-

большие пакеты JavaScript;

-

слишком большие изображения и медиафайлы;

-

слабая инфраструктура.

Каждый из этих факторов может немного замедлять загрузку страницы в браузере.

Хотя разница составляет порой доли секунды, совокупное влияние этих проблем на пользовательский опыт достаточно сильное. Именно поэтому в поиске позиции наиболее быстрых сайтов обычно выше: Google рассматривает скорость загрузки как один из ключевых факторов ранжирования.

⚙️ Проверяйте контент на вашем сайте с помощью Топвизора

Аудит сайта поможет найти битые ссылки, изображения и проверит, как быстро загружается контент на страницах. Реагируйте на изменения мгновенно — настройте отчёты после проверки и всегда будьте в курсе того, что происходит на вашем сайте.

Скорость загрузки страниц также играет ключевую роль в частоте появления контента в AI Mode.

Недавно Дэн Тейлор проанализировал 2 138 веб‑сайтов, упоминавшихся в ответах AI Mode. Он искал связь между частотой упоминаний и показателями LCP и CLS. Результат показал, что сайты с медленной загрузкой значительно реже упоминаются в ИИ‑режиме.

Также Дэн рассмотрел популярный метод оценки скорости — инструмент Google PageSpeed Insights (PSI). Он объединяет множество показателей, включая LCP и CLS, для формирования общей оценки от 0 до 100. Однако связь между показателями PSI и цитированием в AI Mode не была выявлена.

Хотя PageSpeed Insights полезен для диагностики различных проблем, показатели Core Web Vitals остаются более надёжным индикатором того, насколько быстро и эффективно пользователи и сканеры получают доступ к контенту.

У краулинга тоже есть цена

Ещё в июле Сэм Альтман из OpenAI сообщил Axios, что ChatGPT ежедневно получает 2,5 млрд запросов от пользователей. Для сравнения: SparkToro (сайт недоступен в России) установил, что Google обрабатывает около 16,4 млрд поисковых запросов в день.

LLM, лежащая в основе каждой ИИ‑платформы, отвечает на запросы двумя способами:

-

Используя большой набор обучающих данных.

-

Отправляя ботов или краулеров для проверки и дополнения информации из дополнительных источников в реальном времени.

Например, краулер ChatGPT — ChatGPT‑User — регулярно проверяет сайт SALT.agency. На момент написания статьи за предыдущие семь дней он посетил сайт примерно 6 тыс. раз. За тот же период Googlebot, краулер Google, совершил только 2,5 тыс. визитов.

Ежедневная обработка миллиардов запросов требует колоссальных вычислительных мощностей. OpenAI оценивает, что для реализации текущих планов потребуется 10 гигаватт энергии — примерно столько же, сколько дают десять атомных реакторов.

Каждое из этих 6 тыс. сканирований сайта SALT потребовало определённых вычислительных ресурсов. Если сайт работает медленно или неэффективно, сканер потратит ещё больше ресурсов.

С ростом числа запросов общая стоимость всех сканирований только увеличится. В какой‑то момент ИИ‑платформы будут вынуждены оптимизировать экономическую эффективность краулеров (если они ещё этого не сделали). И сайты, требующие больших ресурсов для сканирования, предпочтут обойти стороной в пользу быстро работающих и легко доступных для чтения.

Возможно, ваш сайт уже недоступен для ИИ

Всё вышесказанное предполагает, что краулер имеет доступ к сайту. Но даже это не гарантировано.

В июле этого года одна из крупнейших в мире CDN — Cloudflare — начала по умолчанию блокировать краулеры. Это могло существенно повлиять на доступность миллионов сайтов для ИИ.

Впервые Cloudflare предоставила владельцам сайтов возможность блокировать ИИ‑краулеры в сентябре 2024 года, и более 1 млн клиентов воспользовались этой функцией. А новая опция оплаты за сканирование позволяет платным пользователям выбирать, каких краулеров пропускать и на каких условиях.

Но ситуация изменилась: блокировка краулеров больше не является выходом. Если сайт и его контент должны быть доступны для ИИ, от функционала Cloudflare придётся отказаться.

Если сайт работает на инфраструктуре Cloudflare и его настройки давно не проверялись, возможно, он стал невидимым для ChatGPT, Claude и Perplexity. Причина не в плохом контенте или технической SEO‑оптимизации, а в напрямую влияющем на видимость решении сторонней платформы, которое вы могли не заметить.

Это реальность, с которой сталкиваются маркетологи: нельзя быть уверенными, что то, что работает сегодня, будет работать завтра. Нельзя также ожидать, что решения, влияющие на видимость в ИИ, всегда принимаются внутри организации.

Что изменить в процессах

Кто несёт ответственность за ошибки

Большинство технических проблем в SEO можно решить, но сначала нужно признать их существование. Для этого требуется выполнить два условия:

-

В организации должен быть человек, ответственный за выявление подобных проблем.

-

Этот человек должен обладать необходимыми навыками и опытом для их решения.

Возможно, это утверждение звучит самоуверенно. Но можно ли сейчас найти в организации человека, который действительно за это отвечает? Кто должен активно выявлять и поднимать вопрос о новой политике Cloudflare? И согласился бы он с вашей оценкой ситуации?

Не стоит перекладывать ответственность на внешних SEO‑партнёров. Агентства могут консультировать клиентов при серьёзных изменениях поисковой системы, таких как грядущий Core Update от Google. Но включает ли ваш договор с ними мониторинг всей инфраструктуры, включая сторонние сервисы? Распространяется ли их ответственность на видимость сайта для ИИ‑краулеров помимо стандартного SEO? Если нет, не стоит ожидать, что они обеспечат доступ этих систем к сайту.

Например, маркетолог может думать, что это ответственность разработчиков, ведь они пишут код. Разработчики должны понимать, что сайт должен хорошо ранжироваться и быть видимым для ИИ, и, конечно, используют методы технического SEO. Однако они всё‑таки не эксперты по техническому SEO, веб‑дизайну или UX. Они выполняют свою работу по определённым инструкциям.

В свою очередь, разработчики ожидают, что SEO‑специалисты будут информировать их о любых технических изменениях. А SEO уверен, что всё в порядке, так как последний технический аудит по стандартному чек‑листу не выявил проблем. Они также считают, что, если бы возникли сложности с видимостью в ИИ, кто‑то уже сообщил бы об этом.

Хватит предполагать — действуйте

Лучший способ избежать проблем — обнаружить их как можно раньше. Если дожидаться, пока они станут очевидными, расходы на устранение значительно превысят стоимость первоначальных проверок и простых профилактических мер.

Также не стоит откладывать проверки до момента, когда видимость бренда в ИИ уже нарушена. Проведите проверки сейчас и устраните все технические проблемы, которые могут затруднить работу ИИ‑сканеров.

Важную роль в этом процессе играет эффективная коммуникация между отделами. Чётко распределите ответственность за мониторинг и принятие мер по каждому фактору, влияющему на видимость бренда в ИИ. Если этого не сделать, любые инвестиции и усилия сотрудников могут оказаться напрасными.

Ещё по теме

Как быстро провести аудит сайта и найти точки роста?

Что делать после аудита и все ли ошибки нужно исправлять

Как сделать качественный SEO‑аудит сайта самостоятельно: полное руководство